La nueva ley de Datos Personales podría nacer vieja por avances de la IA y Big Data

Hoy los datos se combinan para generar nuevos datos y para alimentar algoritmos que deciden sobre nuestra vida o nos agrupan en categorías que son comercializadas , compartidas o vigiladas, a menudo sin consentimiento.

Lejos del radar de los políticos y los medios, en los últimos dos años comenzó en el país un proceso para reformar la actual ley 25.326 de Protección de Datos Personales. Hay un consenso en que la norma aprobada en el 2000 tenía una protección robusta del derecho a la privacidad, pero quedó rezagada ante el avance de la tecnología: cuando se aprobó recién comenzaban a desarrolarse las redes sociales y las aplicaciones de smartphones, el Big Data y la Inteligencia Artificial eran apenas un tema de académicos y profesionales especializados.

¿Cómo protegen nuestros datos las telefónicas?

Como resumió el académico cordobés Enrique Chaparro “hoy los datos no se recolectan, se infieren”, es decir la información personal que entregamos a plataformas y aplicaciones son apenas una parte: muchos datos luego son combinados para generar nuevos datos, para alimentar algoritmos que luego toman decisiones sobre nuestra vida o nos agrupan en ciertas categorías que son comercializadas y compartidas, o vigiladas por el Estado a menudo sin nuestro consentimiento.

El 27 de marzo pasado se realizó en la Facultad de Derecho de la Universidad de Buenos Aires la charla “Protección de Datos Personales en Argentina: Fortalezas y debilidades de la reforma” de la que participaron destacados académicos, investigadores e integrantes de organizaciones de derechos humanos y de defensa de los derechos civiles.

Los panelistas fueron los abogados Paula Litvachky (del CELS), Franco Giandana (de la ong Access Now), Agustin Allende Larreta (PRIVACYVITAS) Johnatan Baldivieso (Observatorio del Derecho a la Ciudad) y Luis García Balcarce (ADC), la moderadora fue Beatriz Busaniche (Fundación Vía Libre).

Los especialistas debatieron sobre el nuevo proyecto de ley de Protección de Datos Personales, que actualmente se encuentra en la Secretaría Legal y Técnica de la Presidencia de la Nación, que le dará forma de proyecto de ley para ser enviado próximamente al Congreso.

Entre las observaciones al proyecto, se destacó que, si bien toma como referencia el Reglamento General Europeo, de 2016, los avances tecnológicos y nuevos desafíos podrían hacer obsoleto el proyecto incluso antes de ser debatido.

Las observaciones

• Un derecho humano. El abogado Allende Larreta señaló que es positivo que el texto tome el modelo europeo, que considera el acceso a datos y la privacidad como un derecho humano, la “autodeterminación informativa”, frente al modelo estadounidense enfocado más en el derecho del consumidor. Sin embargo, alertó que “el reglamento europeo no consideró la Inteligencia Artificial, que seis años después tiene otra velocidad a la de las leyes. Hay principios básicos, como el de minimización de datos, (pedir los datos mínimos necesarios) dado que la IA pide cada vez mayor cantidad de datos, incluso para utilizaciones futuras , no se sabe bien para qué” explicó.

• Transparencia. Litvatchky, también abogada, señaló que es necesario que “se descorra el secreto y tanto el Estado como las empresas muestren los datos que tienen sobre nosotros. El avance de la tecnología de la vigilancia y la seguridad pública y privada hace que el Estado y las empresas recopilen cada vez más datos sobre las personas con distintas finalidades, la pregunta es qué tipo de regulaciones debe haber para que puedan recopilar estos datos, qué tipo de datos pueden recabar y tratar, con qué finalidades y que protección tenemos las personas frente al manejo de esos datos. Hay casos concretos en que ese manejo afecta la vida de las personas, la privacidad, la libertad, su expresión”.

• Consentimiento real .Johnatan Baldivieso enfatizó en la necesidad de establecer claramente el consentimiento para entregar o no los datos a empresas. “Hoy no somos solo usuarios o consumidores que entregan sus datos para un fin, sino que somos un producto de explotación económica, para la minería de datos y el Big Data, que da un beneficio”, señaló. “No tenemos posibilidad de discutir los términos, solo aceptar o no”, agregó.

• Datos derivados. Giandana destacó que la ley debiera contemplar “el avance de la capacidad de procesar y relacionar los datos que intercambiamos que tienen las nuevas tecnologías, que extraen de nuestras interacciones para generar nuevos datos que afectarán futuras interacciones”, explicó.

• A favor del usuario, primero. Balcarce reclamó que “cualquier interpretación de la ley se haga siempre en favor del titular de los datos primero. Muchas veces se usan datos sensibles, como los antecedente penales o las contravenciones para perfilar a las personas”, sin su consentimiento ni posibilidad de corregirlos.

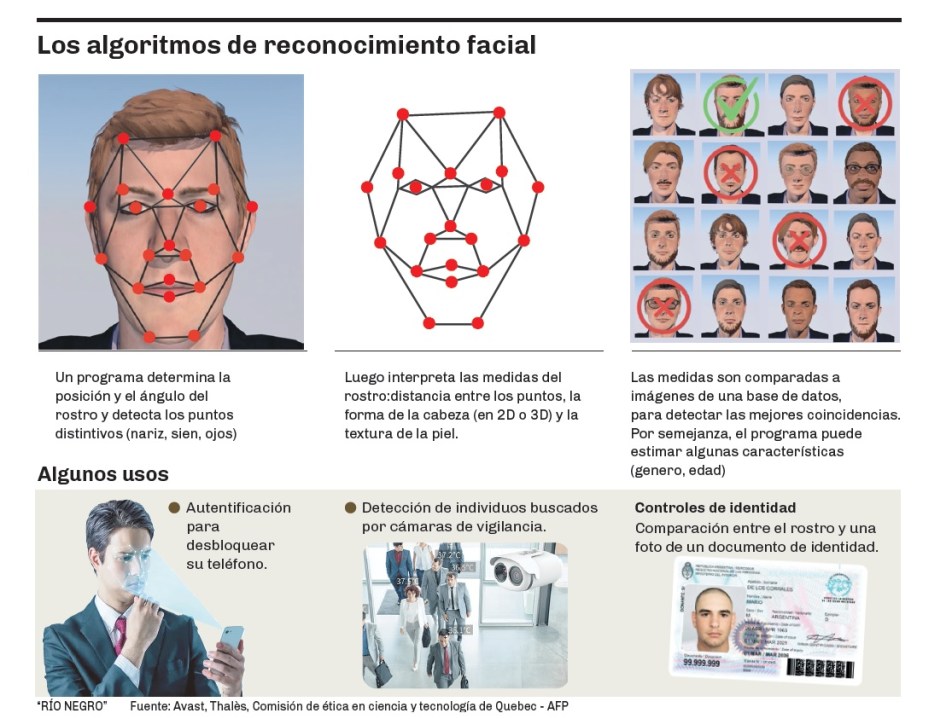

• Reconocimiento facial e inocencia. Giandana destacó que el reconocimiento facial “revierte el principio de inocencia, ya que sobre cualquier transeúnte pesa la sospecha de que sea una persona peligrosa, un delincuente al que se debe aprehender. Un hombre estuvo detenido 6 días porque la máquina se equivocó, hay muchos falsos positivos y falsos negativos. Las cámaras tienen sesgo, por ejemplo hay menor porcentaje de validación de identidad en personas de piel oscura, de edad avanzada o mujeres. La veracidad del sistema es muy pobre” graficó.

Reconocimiento facial: solución o más problemas

Tras una serie de denuncias sobre estafas y espionaje telefónico utilizando el sistema de “SIM swapping”, el Ente Nacional de Telecomunicaciones (Enacom) anunció en marzo que las empresas prestatarias del servicio tendrán un plazo de 60 días para aplicar sistemas de reconocimiento biométricos para confirmar la identidad de sus clientes .

De esta manera, a partir de mediados de mayo, las empresas prestadoras del servicio de comunicaciones móviles deberán solicitar a los usuarios datos biométricos que permitan validar su identidad para autorizar el cambio o reposición de una tarjeta SIM, con el objetivo de garantizar la entrega a su verdadero titular, anunció el organismo. El objetivo es evitar una estafa cada vez más común : que alguien obtenga fácilmente un chip de línea telefónica haciéndose pasar por otra persona, apoderarse del celular y así controlar sus cuentas de WhatsApp, redes sociales, o aplicaciones bancarias.

El caso notorio más reciente fue el del exministro de Seguridad porteño, Marcelo D’Alessandro, a quien le hackearon su teléfono mediante este sistema, desatando el escándalo que se conoce como de los “Huemules”, donde los chat filtrados ventilan el viaje de jueces y funcionarios a Lago Escondido, la propiedad del magnate Joe Lewis en la cordillera rionegrina. En este caso no hubo sólo vulneración de la seguridad de la empresa telefónica sino también del Registro Nacional de las Personas (Renaper) donde el hacker misionero obtuvo los datos personales de D’Alessandro para pedir el cambio del chip. Este fue el caso más conocido, sin embargo se han reportado miles de estafas de casos similares a ciudadanos comunes.

Según la nueva reglamentación, a la hora de gestionar un nuevo número, las empresas deberán solicitar entre otros datos, el número de trámite del DNI y la fecha de emisión del mismo; y para el cambio o reposición de la tarjeta SIM, “deberán revalidar la identidad de su usuario empleando mecanismos de validación de sus datos biométricos”, estableciéndose que “en caso de utilizar imágenes de rostros, éstos deberán capturarse utilizando los lineamientos de la Normativa 9303 de la Organización de Aviación Civil Internacional (OACI)”.

Al respecto, Debates consultó a la abogada de ADC Victoria Penas, quien alertó sobre algunos temas.

“Este tipo de iniciativas en el contexto actual en materia de políticas de seguridad no son necesariamente las mejores. Porque puede traer beneficios desde el punto de vista de la seguridad, y ese es el fin de la herramienta, pero sigue implicando más recolección de datos sensibles en manos de empresas en un contexto donde esa recolección no es del todo segura. Hay que evaluar con criterio y de manera proporcional si la implementación de estas herramientas sirve y genera realmente más beneficios que costos, o si es a la inversa. Entendemos que es una de las prácticas que amerita debatir o cuestionar más antes de su implementación”, señaló.

Formá parte de nuestra comunidad de lectores

Más de un siglo comprometidos con nuestra comunidad. Elegí la mejor información, análisis y entretenimiento, desde la Patagonia para todo el país.

Quiero mi suscripción

Comentarios